Noviembre, 2022

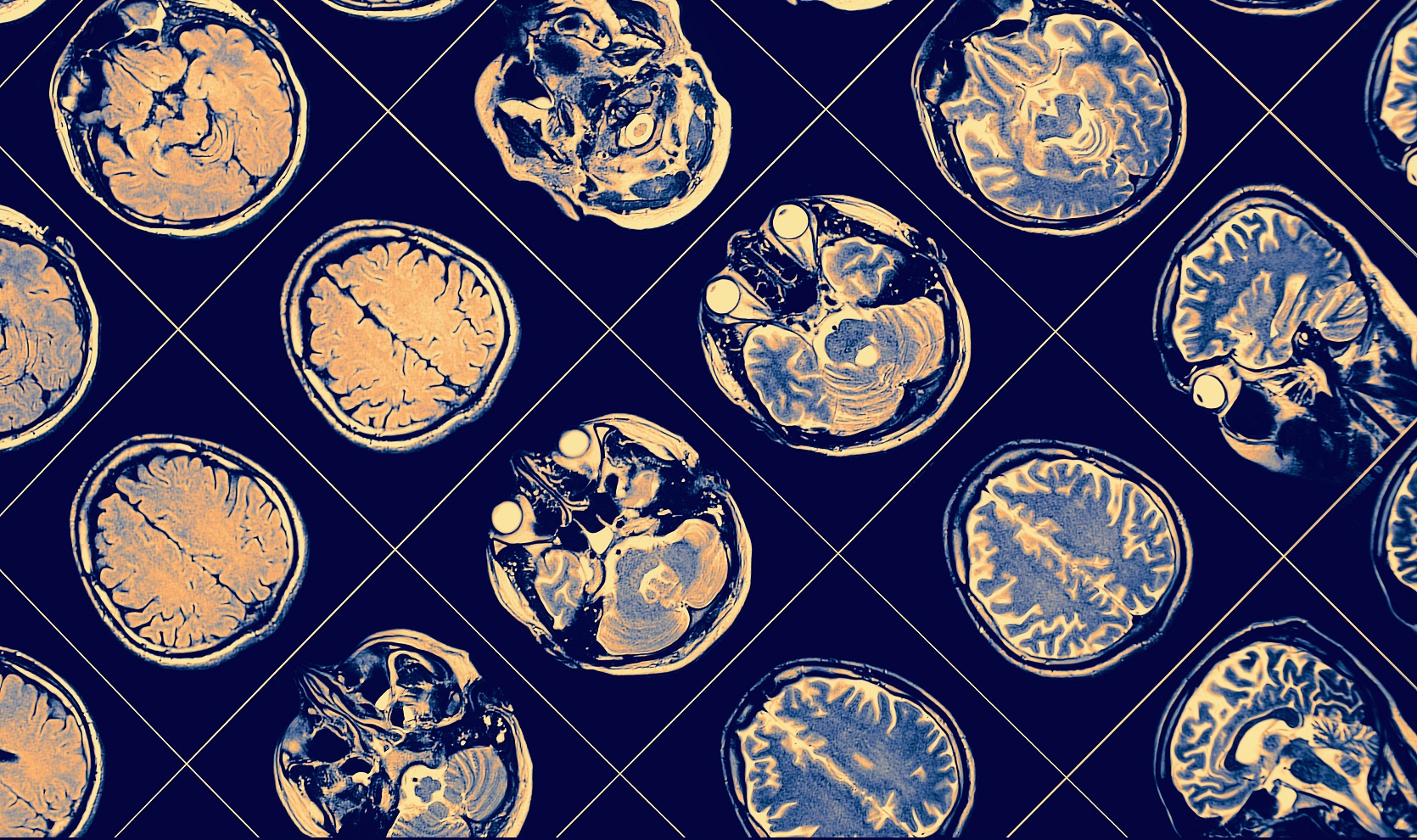

Los científicos llevan años concentrados en resolver el problema del alzhéimer combatiendo los cúmulos de proteína beta-amiloide. Pero ¿y si el alzhéimer fuera, en realidad, un trastorno del sistema inmunitario dentro del cerebro? De esto nos habla el investigador Donald Weaver. Por otro lado, Víctor Rodríguez nos explica el reto de ‘fotografiar’ la huella eléctrica que deja el alzhéimer. Analizar con ayuda de las matemáticas las señales que emite un cerebro afectado por el alzhéimer permite adelantar el diagnóstico, mejorar los tratamientos y afinar en las evaluaciones cognitivas.

El reto de ‘fotografiar’ la huella eléctrica que deja el alzhéimer para encontrar sus puntos débiles

Víctor Rodríguez González

¿Se imagina un universo concentrado en un objeto de algo más de un kilo? Lo tiene más cerca de lo que imagina. Me refiero a su cerebro, el sistema biológico más complejo que se conoce. Y por tanto, el más difícil de analizar y comprender.

El cerebro está formado por unos 20 000 millones de neuronas que están continuamente intercambiando información entre sí. Un puzle muy complicado en el que cada pieza es importante. Un puzle optimizado gracias a millones de años de evolución y del que apenas entendemos una mínima parte.

Esta extrema complejidad es un regalo único, pues habilita funciones cognitivas superiores. Sin embargo, también supone un enorme desafío para los que nos dedicamos a estudiar esta máquina tan compleja, que a veces falla.

Imágenes y fórmulas

Existen multitud de enfermedades que alteran el funcionamiento de nuestro cerebro, pero todavía ignoramos las causas de muchas de esas alteraciones. Por suerte, existe una gran comunidad de científicos tratando de cambiar esto. Necesitamos entender esas dolencias para poder combatirlas de una manera efectiva. ¿Podemos medir de alguna manera el daño que provocan? O, dicho de otro modo, ¿podemos descifrar la huella fisiopatológica que producen?

Para responder estas preguntas, la ciencia hace uso de dos herramientas. Por un lado, las técnicas de imagen cerebral, como la electroencefalografía o la magnetoencefalografía, que nos permiten registrar las señales eléctricas que genera nuestro cerebro. Y, por el otro, los métodos matemáticos, que nos dan un marco inmejorable para exprimir toda la información que contienen estas señales.

Tales métodos abarcan desde técnicas relativamente sencillas, como medir la velocidad promedio de las ondas cerebrales, hasta las técnicas más modernas y avanzadas de inteligencia artificial. Si de construir una casa se tratase, las señales cerebrales serían los ladrillos y las matemáticas el cemento que los une.

Empleamos estos procedimientos matemáticos para estudiar la actividad cerebral buscando ciertos patrones de interés. Es decir, cualquier alteración que se haya producido en el cerebro por causa, directa o indirecta, de una enfermedad.

Objetivo: entender el alzhéimer

Ahora vamos a centrarnos en la demencia por enfermedad de Alzheimer, que afecta a 55 millones de personas en el mundo. Además, su aumento exponencial está provocando grandes problemas a nivel social, médico y económico en los últimos años.

Entender el alzhéimer, descubrir su huella, nos da una gran ventaja táctica en nuestra lucha contra ella. Antes de enfrentarnos a un enemigo poderoso, tenemos que conocerlo bien.

En primer lugar, conocer la firma que deja en el cerebro puede ayudar a los médicos a realizar un diagnóstico más temprano. Para ello se han propuesto numerosos marcadores: señales cerebrales más lentas, menos complejas e irregulares o la desconexión progresiva entre las distintas áreas cerebrales. En este sentido, se están consiguiendo grandes avances, pues se ha logrado diagnosticar la dolencia con una elevada precisión únicamente a través de ese tipo de señales.

Terapias que funcionan

Analizar tales marcas también nos puede ayudar con otro de los grandes problemas de la lucha contra la demencia: la ausencia de tratamientos efectivos. Los resultados de las pocas terapias que existen dependen en gran medida de la respuesta de cada paciente: mientras que algunos presentan grandes mejorías, otros apenas se ven afectados.

En este sentido, podemos encontrar patrones en las señales cerebrales que nos ayuden a predecir y cuantificar el resultado de las intervenciones. Así, hemos podido observar que un tratamiento no farmacológico que se aplica en un centro asociado al hospital Hokuto (Japón) funciona mejor cuando los pacientes presentan menor alteración cerebral, al margen de los síntomas.

Esta terapia se basa en el entrenamiento físico y cognitivo, el fomento de la sociabilidad y la realización de actividades transversales como la horticultura.

La probabilidad de éxito de otro tratamiento similar, aplicado en el hospital Kumagaya General (también en Japón), presentó igualmente una relación directa con las alteraciones en ciertas regiones del cerebro.

Evaluaciones más certeras

Otro campo en el que nos pueden ser de utilidad las señales cerebrales es el de la evaluación cognitiva del paciente. Actualmente se utilizan cuestionarios para medir distintas capacidades, como el aprendizaje, la memoria o las funciones ejecutivas, como se denominan los procesos cognitivos dirigidos a alcanzar una meta. Sin embargo, estas pruebas tienen unas desventajas notables, ya que sus resultados pueden variar en función del profesional que las aplica, del estado de ánimo del sujeto o, incluso, de posibles sesgos culturales.

Hasta ahora hemos podido comprobar que la cantidad de actividad cerebral de tipo alfa, una clase de onda que aparece en estados de relajación y es fácilmente identificable, está relacionada con la capacidad de aprendizaje y memoria. Además, también se ha demostrado que la función ejecutiva parece estar vinculada con la complejidad de las señales cerebrales.

Asociar parámetros extraídos de las señales cerebrales a las distintas funciones cognitivas ayudaría a reducir la subjetividad de los cuestionarios. Además, también permitiría medir estas capacidades en personas con problemas de comunicación y que, por tanto, no pueden realizar las pruebas que se utilizan ahora.

Estamos avanzando hacia una medicina personalizada. El objetivo es que mediante el análisis de la actividad cerebral podamos mapear las regiones en las que cada paciente presenta mayores alteraciones. De esta manera, podremos diseñar tratamientos diana, enfocados a abordar esas disfunciones específicas. Y, por qué no, lograr que un diagnóstico de demencia pase de ser un callejón sin salida a un camino de esperanza. ![]()

Víctor Rodríguez González: predoctoral researcher, Universidad de Valladolid.

▪️◾▪️

Hay motivos para sospechar que el alzhéimer podría ser una enfermedad autoinmune

Donald Weaver

Encontrar una cura para la enfermedad de alzhéimer se está convirtiendo en un desafío cada vez más competitivo y polémico, y en los últimos años se han producido varias controversias importantes.

Sin ir más lejos, en julio de 2022, la revista Science informó de que un trabajo de investigación clave de 2006 que identificaba un subtipo de proteína cerebral llamada beta-amiloide como la causa del alzhéimer podría haberse basado en datos inventados.

Un año antes, en junio de 2021, la Administración de Alimentos y Medicamentos de Estados Unidos había aprobado un anticuerpo dirigido al beta-amiloide llamado aducanumab como tratamiento para el alzhéimer, a pesar de que los datos que apoyaban su uso eran incompletos y contradictorios.

Si hay millones de personas que necesitan un tratamiento eficaz, ¿como es que los investigadores siguen dando tumbos? ¿Por qué no han dado aún con una cura para la que es posiblemente una de las enfermedades más importantes a las que se enfrenta la humanidad?

Escapar de la rutina del beta-amiloide

Durante años, los tratamientos para el alzhéimer se han centrado en evitar la formación de cúmulos de esa misteriosa proteína que daña el cerebro llamada beta-amiloide. De hecho, podría decirse que los científicos nos hemos metido en un pequeño bache intelectual al concentrarnos casi exclusivamente en este enfoque, a menudo descuidando o incluso ignorando otras posibles explicaciones.

Lamentablemente, esta dedicación al estudio de los cúmulos de proteínas anormales no se ha traducido en un fármaco o terapia útil. La necesidad de una nueva forma de pensar sobre el alzhéimer “fuera de los cúmulos” se está convirtiendo en una de las principales prioridades de la ciencia del cerebro.

Mi laboratorio del Krembil Brain Institute, que forma parte de la University Health Network de Toronto, está ideando una nueva teoría de la enfermedad de Alzheimer. Basándonos en nuestros últimos 30 años de investigación, no pensamos en ella como una enfermedad neuronal. Más bien, creemos que el alzhéimer es principalmente un trastorno del sistema inmunitario dentro del cerebro.

El sistema inmunitario, que se encuentra en todos los órganos del cuerpo, se compone de células y moléculas que trabajan en armonía para ayudar a reparar lesiones y proteger de invasores extraños. Cuando una persona tropieza y se cae, el sistema inmunitario ayuda a reparar los tejidos dañados. Cuando alguien experimenta una infección viral o bacteriana, el sistema inmunitario ayuda en la lucha contra estos invasores microbianos.

Pues bien, en el cerebro los procesos son exactamente los mismos. Cuando hay un traumatismo craneal, el sistema inmunitario cerebral se pone en marcha para ayudar a reparar. Y si hay bacterias invasoras, el sistema inmunitario está ahí para combatirlas.

El alzhéimer como enfermedad autoinmune

Creemos que la beta-amiloide no es una proteína anómala, sino que es una molécula que se genera con normalidad y que forma parte del sistema inmunitario del cerebro. Cuando se produce un traumatismo cerebral o cuando hay bacterias en el cerebro, la beta-amiloide sería un elemento clave de la respuesta inmunitaria global del cerebro. Y aquí es donde empieza el problema.

Debido a las sorprendentes similitudes entre las moléculas de grasa que componen las membranas de las bacterias y las membranas de las células cerebrales, el beta-amiloide no puede distinguir entre las bacterias invasoras y las células cerebrales anfitrionas. Así que ataca por error a las mismas células cerebrales que se supone que está protegiendo.

Esto conduce a una pérdida crónica y progresiva de la función de las células cerebrales, que finalmente culmina en la demencia.

Si el origen del problema es un ataque mal dirigido del sistema inmunitario del cerebro contra el mismo órgano que se supone que debe defender, entonces la enfermedad de Alzheimer puede considerarse autoinmune.

Hay muchos tipos de enfermedades autoinmunes, como la artritis reumatoide, en las que los autoanticuerpos desempeñan un papel crucial en el desarrollo de la enfermedad, y para las que las terapias basadas en esteroides pueden ser eficaces. Pero estas terapias no funcionarán contra la enfermedad de Alzheimer. Al fin y al cabo, el cerebro es un órgano muy especial, reconocido como la estructura más compleja del universo.

Sin embargo, incluso si los fármacos utilizados convencionalmente en el tratamiento de las enfermedades autoinmunes fallan en el cerebro, creemos firmemente que trabajar con otras vías de regulación inmunitaria en el órgano pensante nos conducirá a enfoques de tratamiento nuevos y eficaces frente a la enfermedad.

Otras teorías de la enfermedad

Además de esta teoría autoinmune del alzhéimer, están empezando a aparecer muchos otros enfoques. Por ejemplo, algunos científicos defienden que el alzhéimer es una enfermedad de unas diminutas estructuras celulares llamadas mitocondrias, las centrales energéticas de las células. Las mitocondrias convierten el oxígeno del aire que respiramos y la glucosa de los alimentos que ingerimos en la energía necesaria para recordar y pensar.

Otros sostienen que es el resultado final de una infección cerebral particular, con bacterias de la boca como principales sospechosas. También los hay que apuntan a que el origen está en una manipulación anormal de metales en el cerebro, posiblemente zinc, cobre o hierro.

En cualquier caso, el alzhéimer es una crisis de salud pública que necesita ideas innovadoras y nuevas orientaciones. Es gratificante ver nuevas ideas sobre esta antigua enfermedad. No olvidemos que la demencia afecta actualmente a más de 50 millones de personas en todo el mundo, con un nuevo diagnóstico cada tres segundos.

Por el bienestar de las personas y las familias que viven con la demencia, y por el impacto socioeconómico en nuestro ya estresado sistema sanitario que hace frente a los costes y demandas cada vez mayores de la demencia, necesitamos comprender mejor el alzhéimer, sus causas y lo que podemos hacer para tratarlo y ayudar a las personas y familias que viven con él. (Este artículo fue publicado originalmente en inglés). ![]()